A.I. – eller Kunstig Intelligens – har det seneste år fyldt meget i medierne, og det er næppe nogen overdrivelse at kalde den teknologiske udvikling et paradigmeskifte på linje med udbredelsen af Internettet i slutningen af 90’erne. Også kunsten må nødvendigvis forholde sig til fænomenet – hvad enten vi taler konkrete udfordringer nu og her, eller mere langsigtede perspektiver. Bliv lidt klogere på nogle af problemstillingerne nedenfor.

“Daisy, Daisy, Give me your answer, do!”

Citatet fra sangen Daisy Bell blev i 1961 som det første ytret med et stemmesyntetiseringsprogram af en IBM 704 på Bell Labs i USA. Citatet blev senere gentaget i klimakset på Stanley Kubricks ikoniske film Rumrejsen 2001 (1968), hvor astronauten Jim Bowman i et darwinistisk ‘survival of the fittest’ må deaktivere den selvbevidste supercomputer HAL9000, der har besluttet sig for at dræbe rumskibets besætning for at sikre missionens succes.

En af filmens centrale tematikker omhandler spørgsmålet om teknologiens rolle i menneskets videre evolution: Vil teknologien være et hjælpende værktøj, der frisætter mennesket, eller vil den stigende automatisering fratage mennesket dets agens – og måske, som i filmens yderste konsekvens, søge at kvæle og erstatte mennesket fuldstændigt?

Vi er stadig et stykke vej fra “ægte” Kunstig Intelligens som HAL9000. Og selvom udviklingen netop nu accelererer, så det er vanskeligt at skrive en meningsfuld artikel om emnet, før man bliver overhalet indenom af virkeligheden, er der bred enighed om, at sådanne scenarier fortsat ligger et stykke ude i fremtiden. Men perspektiverne her og nu er ikke desto mindre stadig vidtrækkende.

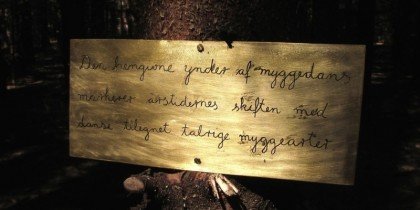

Kars Simms Evolved Virtual Creatures (1994) er et tidligt eksempel på udviklingen af primitiv kunstig intelligens, hvor digital “livsformer” på et “amøbestadie”, bliver bedt om at udvikle løsninger på simple opgaver.

Machine Learning, Generativ A.I. og “ægte” kunstig intelligens

A.I., eller ‘Kunstig Intelligens’, kan opdeles i tre hovedkategorier: På den ene side er der “ægte” A.I., som HAL9000, hvor den kunstige intelligens har udviklet egentlig bevidsthed. Og på den anden side har vi Generativ A.I. og Machine Learning, som er den form for kunstig intelligens, der er på færde, når vi taler om de chatbots og billedgeneratorer, som eksempelvis ChatGTP og MidJourney, som i skrivende stund integreres i alt fra søgemaskiner til de tekst- og billedbehandlingsprogrammer, vi benytter i hverdagen.

Groft sagt handler Machine Learning om at genkende informationer i store datasæt (f.eks. ansigtsgenkendelse). Generativ A.I. tager skridtet videre og bruger disse informationer til at generere nye billeder og tekst. Fælles for dem begge er dog, at de på et fundamentalt plan baserer sig på statistik, så algoritmerne “tænker” ikke, eller har en bevidsthed i traditionel forstand, men gennemsøger blot et datasæt på millioner af mulige svar og vælger så den løsning, som statistisk virker mest sandsynlig i den givne sammenhæng.

Når maskinen ser på billeder

Generativ A.I. er resultatet af en udvikling, der har stået på i 30 år, men som for alvor tog fart omkring årtusindskiftet – ikke mindst accelereret af terrorangrebene 11. september 2001, som afstedkom et ønske om øget overvågning af strategisk infrastruktur, især lufthavne. Ønskescenariet for mange stater var et automatiseret system med ansigtsgenkendelse, der kunne identificere terrorister, inden de steg ombord på et fly.

Automatiseret ansigtsgenkendelse rejser dog et helt fundamentalt spørgsmål, for hvordan lærer man en maskine at “se”? For maskinen er det digitale billede blot en algoritme, en serie af 0’er og 1-taller, så hvordan omsætter man dette input til noget, computeren kan genkende som et ansigt – endsige et ansigt fra én bestemt person, der tilmed kan være vist fra mange forskellige vinkler, i forskellig belysning, med forskellig påklædning, frisure etc.? Alt sammen variationer, som falder mennesker ret naturligt at afkode, men som for en maskine ingenlunde er indlysende.

Svaret handler om statistik. Om det, der også kaldes “Big Data” – altså de enorme datamængder, vi hele tiden genererer, når vi interagerer med digitale medier. Skal maskinen lære at genkende ansigter, må vi fodre den med et enormt datasæt af ansigtsbilleder i alle tænkelige afskygninger og situationer.

En faustisk handel

Udviklingen af smartphonen og de sociale medier blev den katalysator, der for alvor satte skub i datahøsten: Et internet, hvor applikationer og services på overfladen står til fri afbenyttelse, men som brugerne hele tiden fodrer med informationer, som tech-firmaerne kan videresælge eller anvende til udvikling af nye produkter.

Snapchats ansigtsfiltre analyserer hver dag millioner af ansigter, facebook og Google høster data om vores adfærd og helbredstilstand – ja selv når vi udfylder CAPTCHA-tests for at verificere, at vi er en menneskelig bruger og ikke en bot, og eksempelvis bliver bedt om at identificere busser eller biler på et billede, bliver vores input i virkeligheden brugt til at træne en algoritme, der skal bruges i selvkørende biler.

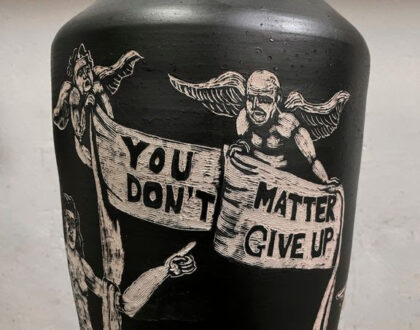

Udtrykket “There is no such thing as free lunch” har i årevis floreret online til at beskrive den faustiske handel vi indgår i, når vi benytter de (tilsyneladende) gratis, digitale tjenester. Dette forhold tematiseres også i Cecilie Waagner Falkenstrøms værk A Faustian Friendship (2022), hvor publikum inviteres til at blive venner med den kunstige intelligens Mephisto; et venskab, hvis pris er informationer om os selv. Værket illustrerer, hvordan vi i vores interaktion med A.I. også træner den, ved hele tiden at udvide dens referenceramme med nye data.

Den massive strøm af personlige informationer, som vi dagligt overlader til fremmede at håndtere, ville gøre hedengangne STASI grønne af misundelse, og spørgsmålet om Big Data og overvågning er et interessant, men omfattende kapitel for sig, men må i nærværende tekst reduceres til blot at handle om, at disse enorme datamængder er den muld, hvori Generativ A.I. henter sin næring.

Generativ A.I.

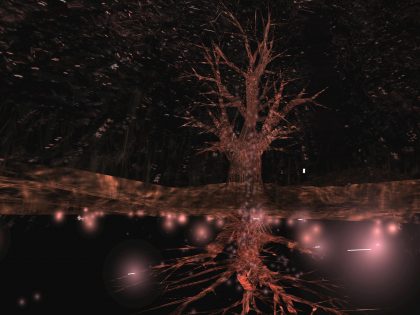

Det “folkelige gennembrud” inden for billedgenererende A.I. skete i 2016, da Google annoncerede algoritmen Deep Dream. Her var datasættet ofte baseret på billeder af dyr, som algoritmen forsøgte at genkende i fotos, som brugerne uploadede – ofte med nærmest psykedelisk trippede resultater.

To år senere, i 2018, præsenterede kunstnerkollektivet Obvious værket Edmond de Bellamy, hvor en algoritme var blevet fodret med portrætter fra WikiArts arkiv, og havde genereret sit første algoritmeskabte “maleri”, der sidenhen blev solgt på auktion for $432.500 dollars.

Men med deres ophav i statistik er de nye billeder stadig fejlbehæftede og afspejler alle mulige former for fejltolkning og bias, der røber et misforhold imellem dét, vi tror, vi beder maskinen om at producere, og det output, der faktisk skabes. Usammenhængende kroppe, overdrevne stereotyper og tvivlsomme kausalforhold og logik imellem billedets elementer gør derfor i skrivende stund mange A.I.-genererede billeder ufrivilligt komiske.

Kunstnere kan bruge dette til at pege på fejl og strukturelle bias i de underliggende data, der genererer billedet – for under komikken lurer en mere alvorlig udfordring: I takt med at billeddannelsen sker stadigt mere sømløst, bliver det også vanskeligere at gennemskue disse strukturelle problemer i datasættene.

Transparens og modstand

Heidegger forudså dette forhold med begreberne vorhanden og zuhanden, hvor han brugte en hammer som analogi: For den utrænede er hammeren et kluntet værktøj, hvor vi hele tiden er bevidste om hammerens tilstedeværelse, når vi bruger den (Vorhanden). For den garvede tømrer er hammeren en naturlig forlængelse af kroppen, hvor forbindelsen mellem menneske og værktøj synes udflydende (Zuhanden).

Betragter man A.I. som et værktøj på linje med Heideggers hammer, er vi, så længe de A.I. genererede billeder er fulde af synlige fejl (“glitches”), bevidste om disses kunstighed, men i takt med at teknologien forfines er vi ved at miste evnen til at foretage denne skelnen.

Det afgørende er naturligvis, at vi allerede nu er bevidste om kvaliteten af den hammer, vi tømrer fremtidens infrastruktur sammen med. Er det overhovedet en god hammer? Vil vi ukritisk bruge en hammer, som i 98% af tilfældene slår søm i, men som i de resterende 2% gør noget uventet, uhensigtsmæssigt, eller ligefrem farligt?

En af kunstens vigtige roller i denne sammenhæng er at minde os om at træde et skridt tilbage, betragte teknologien kritisk, Vorhanden, og stille spørgsmålstegn ved de underliggende strukturer, der former den. For så længe tech-virksomhederne nidkært vogter over algoritmernes source code og ikke tillader kritiske gennemsyn, er vi som brugere tvunget til blot at have blind tillid til, at den teknologi, vi integrerer i stadigt flere sammenhænge, ikke baserer sig på fejlbehæftede datasæt og skjulte bias. En tillid, der absolut ikke er velbegrundet.

En surrealistisk idégenerator

For kunstnere, arkitekter, designere og andre, der bruger visuelle medier i deres daglige praksis, kan generativ A.I. dog være et nyttigt værktøj til idégenerering eller løsning af simple, illustrationsopgaver, som tidligere har været tidskrævende.

Maskinbilledernes “fejl” er ikke styret af en logik eller vanetænkning, tøjlet af levede, kropslige erfaringer fra en fysisk virkelighed. Det kommer ofte til udtryk i A.I.-billeder, hvori man aner et slægtskab med surrealismens automattegninger, som netop forsøgte at frakoble den logiske bevidsthed fra den billedskabende proces. “Smuk som det tilfældige møde mellem en symaskine og en paraply på et dissektionsbord” var nok surrealisternes mantra, men indtastet i MidJourneys kommandoprompt er det blot endnu en opgave, der skal løses.

A.I. åbner også helt nye muligheder for billeddannelse, som udfordrer vores traditionelle forståelse af, hvad et billede er. Teknologien kan forbedre fotografiske processer eller skabe helt nye – eksempelvis billeder baseret på analyse af WiFi-signaler eller såkalt “paragrafi“, en slags fotografi, baseret på geolokationsdata og en billeddatabase, der i stedet for en fotografisk proces genererer billeder ved hjælp af tekst-til-billede A.I.. Det kreative potentiale i denne form for A.I.-assisteret datamanipulation er enormt.

Men er det god kunst?

“Jeder Mensch ist ein Künstler”, proklamerede Joseph Beuys i 1966. Med Generativ A.I. er dét at udtrykke sig igennem æstetisk dragende billeder blevet lettere end nogensinde før, og i den forstand kan man argumentere for, at kunstnerisk udfoldelse er blevet mere demokratisk.

Men selvom demokratisering og automatisering af kunstproduktionen trækker tråde tilbage til avantgardebevægelserne i begyndelsen af det 20. århundrede, betonede disse bevægelser samtidig værkets koncept, modstand og kritik over ren æstetik. Et værk er ikke god kunst alene fordi det er “pænt”. Her repræsenterer billedgeneratorernes masseproduktion og strukturelle konvergens mod det gennemsnitlige en modsatrettet bevægelse, der som minimum udfordrer det eksisterende kunstbegreb.

Endvidere rejser brugen af Generativ A.I. også komplekse spørgsmål om ophavsret, for hvis billederne sammensættes af millioner af andre billeder, hvem er så “kunstneren”, og hvem ejer rettighederne? De oprindelige rettighedshavere? Firmaet bag algoritmerne? Slutbrugeren? Hvad stiller vi op, hvis hudpixels fra vores private selfies pludselig optræder i et A.I.-genereret portrætfoto, der reklamerer for et hudplejeprodukt? Også lovgivningen har svært ved at følge med udviklingen!

Læs også: Bag maskinens pixelerede blik

Hvad gemmer sig i den sorte æske?

A.I. kommer til at ændre mange af de arbejdsprocesser, vi skaber kunst med, men i forhold til billedskabelse er det først og fremmest som et værktøj. Som kunst betragtet er de A.I.genererede billeder mindre interessante som æstetiske objekter i sig selv, men får primært værdi i den udstrækning de kan bruges til selvrefleksivt og kritisk at undersøge de algoritmer og overordnede samfundsmæssige strukturer, der er deres ophav. Og at der er behov for sådanne gennemsyn synes åbenbart, i takt med at teknologien bliver stadig mere integreret, og dens tilstedeværelse stadig vanskeligere for slutbrugeren at identificere.

At den nu fyrede Google-ingeniør Blake Lemonie tidligere i år oprigtigt mente, at firmaets LaMDA A.I. havde udviklet ægte bevidsthed, illustrerer udmærket det helt grundlæggende problem: Teknologien er nu så fremskreden, at den til forveksling ligner noget for mennesket velkendt – og derved slører den sin fundamentale ikke-menneskelige natur. Vi skal derfor lære at omgås den nye teknologi og kende dens faldgruber.

Menneskets biologi har ikke forandret sig nævneværdigt de seneste 200.000 år, og i vores omgang med A.I er vi slet ikke gearet til at håndtere, at interfacet – den “bevidsthed”, vi tror vi kommunikerer med – i virkeligheden er noget fundamentalt ikke-menneskeligt og fremmedartet. En yndet analogi her er, hvis en edderkop gennem hastig evolution havde udviklet menneskelignende træk: Den foregiver at være et menneske, men på et fundamentalt plan er det stadig en edderkop – og det er ikke nogen helt rar tanke!

Siden neandertalerne uddøde for 25.000 år siden, har Homo Sapiens været den dominerende intelligente art på planeten. Det vedbliver vi nok med at være en stund endnu. Men når vi taler kunstig intelligens, gør vi klogt i fortsat at betragte det som en form for artificiel dumhed, for al deres informationsrigdom til trods, er A.I. systemerne endnu kun så kloge, som de datasæt vi fodrer dem med.

“Daisy, Daisy, Give me your answer, do!” Daisy synger os sine svar, men tag ikke alle hendes sange for pålydende!