TEMA: Netkunst

Læs om kunst, der er udviklet til at eksistere online, og som bruger nettet som sit ‘materiale’. Med vores temaserie får du baggrundsviden og kendskab til kunstnere indenfor genren.

Kristoffer Ørum og Anders Visti er blandt de danske kunstnere, der arbejder helt nede i maskinrummet bag de digitale informationsstrømme, der gennemsyrer vores hverdag. Her følger anden del af vores interview med de to billedkunstnere, der mener, at vi med udviklingen af kunstig intelligens er i gang med en radikal og kompleks rekonfigurering af selve billeddannelsen.

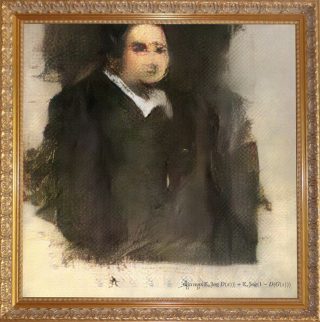

I 2018 solgte auktionshuset Christie’s værket Edmond de Belamy, der var det første portræt skabt af en computer. Værket var genereret af såkaldt Kunstig Intelligens (AI); et af tidens store buzzwords, og et fænomen, der lover store forandringer i samfundet – og måske også i kunsten?

Visionen om en autonom, kunstig intelligens er på en gang den cybernetiske utopis drøm og dens mareridt, for i drømmen om en maskine, der vil kunne frisætte menneskeheden fra arbejdets byrde, ligger også angsten for at skabe et Frankensteins uhyre, der vil tilintetgøre sin skaber. Men hvor er kunstig intelligens i dag? Og er “kunstig intelligens” overhovedet det rette ord at bruge i denne sammenhæng?

Blandingen af fascination og angst finder også udtryk i den digitale kunsts undersøgelser af nye teknologier. Et helt centralt spørgsmål i relation til kunsten er, hvilken betydning maskinerne får, når man som billedkunstner er interesseret i form og betydning. Og netop dette spørgsmål udforsker Kristoffer Ørum og Anders Visti i deres kunstneriske praksis.

“Vi er i virkeligheden i gang en meget dyb og kompleks rekonfigurering af billeddannelse, så selvfølgelig skal vi kigge på de former det antager”, indleder Anders Visti, da samtalen drejer sig ind på spørgsmålet om hvad et digitalt billede i det hele taget er for en størrelse.

Modsat et konventionelt billede, er det digitale billede nemlig ikke blot det, vi ser på skærmen. Det er også de underliggende koder og algoritmer og den proces, der frembringer billedet. Det digitale billede kan således siges på én gang at være tekst, visualitet og en form for automatiseret handling, som Rosemary Lee beskriver det i det manifestlignende værk The image is a machine (2018).

Hvad maskinen ser

Google’s Deep Dream vakte stor opmærksomhed, da programmet i 2015 blev lanceret som det hidtil mest ambitiøst forsøg på, at lære en computer at ‘se’ – eller mere specifikt: At genkende former i digitale billeder.

Deep Dream kan ses som en udløber af den overvågningsteknologi, der udsprang af terrorfrygten efter angrebene d. 11. september i New York, 2001. Computeren skulle lære at genkende potentielle “bad guys” så nye terroranslag kunne forebygges, og dermed satte ønsket om nye ansigtsgenkendelsesteknologier gang i et elektronisk våbenkapløb blandt verdens tech-giganter. Kunstens forhold til ansigtsgenkendelsesteknologier og overvågningssamfund, er et kapitel for sig, og er rigt udforsket af kunstnere, som Adam Broomberg og Oliver Chanarin og i udstillinger, som Watched, der blandt andet har været vist på Kunsthal Aarhus i 2016.

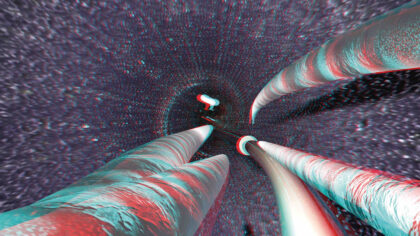

Men hvordan “ser” en maskine egentlig? Deep Dream blev en øjeblikkelig internet-sensation p.g.a. de nærmest psykedeliske billeder, hvor velkendte portrætter bliver forvrænget og fordrejet til at ligne hunde, fugle og fisk. Men bag den visuelt slående leg gemmer sig en dybere alvor: Deep Dreams algoritmer forsøger at genkende former fra et etableret visuelt datasæt. I de psykedeliske Deep Dream-billeder er computeren blevet fodret med billeder af dyr, som maskinen forsøger at genkende – selvom de måske ikke findes i originalbilledet!

Det er samme princip, som er applikeret på portrættet, der blev solgt på Christie’s. Her var den såkaldte Generative Adversarial Network algoritme (GAN) blot fodret med en database af 15.000 klassiske portrætmalerier, som maskinen så forsøgte at skabe et portræt på baggrund af.

Processen bag Deep Dream kaldes også Machine Learning, og datasættene som systemerne trækker på, genereres af os allesammen i vores brug af forskellige medier, fra googlesøgninger over facebook, til Snapchat og stavekontrollen på vores mobiltelefoner.

“AI – eller Machine Learning – bliver en helt naturlig del af den måde, vi beskæftiger os med computere på”, konkluderer Visti: “Og så er der jo alle de her fantasier om maskiner, der begynder at kunne programmere sig selv til at kunne finde ud af ting, som er nogle lidt mere spekulative fremtider. Men “Narrow AI”, som er kunstig intelligens, der fungerer inden for nogle bestemte funktionsområder, tror jeg at der kommer til at være rigtigt meget af. Både i journalistik og i billedkunst og i vores interfaces.”

Bag om datasættene

Ifølge Ørum burde man måske helt undlade at bruge udtryk, som ‘Kunstig Intelligens’ om disse processer, men i stedet kalde det en form for ‘statistik’, eftersom selve ordet lover noget, som ‘Kunstig Intelligens’ ikke er. Grundlæggende er den kunstige intelligens nemlig ikke klogere end den data man fodrer algoritmerne med, og en af udfordringerne er, at sikre overensstemmelse mellem det man tror maskinen gør, og det den faktisk gør.

Googles algoritmer har eksempelvis kigget på billeder af ulve, men eftersom mange at billederne i datasættet er taget med sne som baggrund, er det uklart, om maskinen tror at det er ulven selv, eller sneen i baggrunden, som skal klassificeres som “ulv”.

“Machine Learning kan producere interessante ting, hvis ellers man også er interesseret i hvad det er for nogle datakilder, de kommer fra”, mener Ørum. “Men der er et issue med grundigheden i det kritiske gennemsyn af algoritmerne, som er rigtigt svært, fordi kilderne ofte er beskyttet af ophavsret, så man ikke kan gennemgå dem, og kritisk fastslå hvad de faktisk gør. Man køber bare en sort trold i en kasse, som man skal tro på siger noget klogt.”

Når Ørum laver et værk med en algoritme, der kan genkende næser, men algoritmen ikke kan kende forskel på en næse og en rødbede, handler det i høj grad også om disse datasæt. Af samme årsag er Ørum skeptisk overfor det revolutionære potentiale i værker, som portrættet fra Christie’s, da det grundlæggende blot er remix af kunsthistorien, som vi allerede kender den. “Den ældre kybernetiske drøm om at forandre mennesket foregår hele tiden på mikroniveau, når stavekontrollen driller mig. Og det er egentlig meget mere voldsomt.”

Det er interessen for denne ubevidste påvirkning, som også finder udtryk i Ørums egen kunstneriske praksis: “Jeg er mere bekymret for, om vi ubevidst overlader for meget af vores dømmekraft til disse systemer. Der bliver nødt til at være noget kritisk menneskelighed til stede. Når man kan sælge et værk skabt af en kunstig intelligens på Christie’s, så er der jo en masse kritisk menneskelighed til stede i alle udvælgelsesprocesserne, fra dem, der har udvalgt datasættet, til Christie’s selv, til køberne osv.” Men sådan er det ikke på andre områder, der griber langt mere ind i vores dagligdag.

Maskiner og mennesker i den digitale organisme

LinkedIn lavede for nogle år siden et system, hvor man kunne scanne sit visitkort og få informationerne lagt op på siden. På det tidspunkt en vanskelig opgave for en maskine. “Man skulle bare tage et billede, men så viste det sig, at de bare sendte dem til nogle indere, som de havde hyret til at transskribere det i hånden, stedet for at få en algoritme til at gøre det”, griner Ørum. “Folk blev enormt foruroligede over, at det var et menneske, der sad i den anden ende, i stedet for en algoritme. Så der er både frygt og drømmen om anonymitet forbundet med automatiseringen.”

Også facebook og Instagram benytter sig af en blandingsform, hvor automatiserede systemer scanner medieplaformen for potentielt stødende indhold, mens menneskelige moderatorer først sættes ind i tvivlsspørgsmål. Dette har medført en række komplikationer i eksempelvis kulturlivet, hvor mange kanoniserede kunstværker, som eksempelvis Courbets Verdens Oprindelse (1866), kategoriseres og censureres som værende pornografiske. Maskinen forstår simpelthen ikke den kontekstuelle forskel på “kunst” og “pornografi”.

“Men det tegner jo også et digitalt landskab, der er enormt langstrakt”, supplerer Visti. “Lige pludselig er der måske en eller anden underbetalt arbejder i den anden ende af verden, der har en anpart i dine billeder. Så er det, du troede var en anonym service, i virkeligheden en mechanical turk, der sidder derovre og ordner tingene, når fortællingen udadtil handler om AI og neurale netværk.”

Ørum supplerer: “Hvis det nu ikke skete på denneher globale gak-gak-kapitalismes præmisser, men at de var super velbetalte og at vi også godt vidste det, så ville det jo bare være sådan en slags kollektiv frembringelse af viden, som faktisk har noget smukt i sig. Det er i høj grad, fordi vi har givet hele den infrastruktur til nogle meget få firmaer, at der er problemer.”

Du bliver en hudpixel i et andet menneskes ansigt

Så hvad betyder alt dette for billedets status i den nye digitale verden? Med reference til en artikel af den tyske kunstner Hito Steyerl fortæller Visti om en hollandsk systemudvikler, der har lavet en algoritme, der kan rense billeder taget med mobiltelefonens kamera. Ca 50 % af billedet består nemlig digital “støj”. Udvikleren har derfor skabt en algoritme, der kan identificere hvilke pixels, der ikke hører til billedet, og derefter genskabe de korrekte pixels ved hjælp af en AI, som kan identificere, hvad det er for en type af billede:

“Så hvis det fx. drejer sig om et portræt, kan vi erstatte en fejlagtig “støj-pixel” med en hudfarvet pixel fra et enormt datasæt, der ved hvordan hud-pixler ser ud. Det er mit yndlingseksempel: Når vi fotograferer vores nærmeste, er vores private billeder nu potentielt podet med alle mulige hudpixels fra andre mennesker. Og denne rekonfiguration af billeder foregår potentielt hele tiden internt i disse systemer, og på et tidspunkt kunne man forestille sig, at man selv bliver tilføjet til dette enorme arkiv af ansigter, hvorfra hudpixels trækkes.”

Dermed kompliceres billeddannelsen, og det bliver langt vanskeligere at gennemskue, hvad det er, der konfigurerer billedet. “Der er simpelthen en øvre grænse, hvor den menneskelige kognition ikke helt kan fange, hvad der foregår, fordi det er en enorm sum af relationer mellem data, der egentlig bestemmer, hvad det er, noget forestiller”, forklarer Visti.

Et andet eksempel omhandler de nyeste kameraer i mobiltelefoner, der kan arbejde kunstigt med dybdeskarphed på en måde, der ellers ville kræve tung og dyr optik i et traditionelt kamera. I stedet udvælger en algoritme de elementer i billedet, som den tror er billedets motiv, og slører for og baggrund for en mere fotografisk effekt.

“Teknologierne og algoritmerne er selv blevet medskabere af billedet lige så meget som den person, der tager billedet”, mener Ørum. “Og det tror jeg faktisk, at jeg meget godt kan lide. Teknologien har nok altid været medskaber af billeder, om det så har været via sølvnitrat-fotokemiske processer i det analoge fotografi. Nogle af de ting er måske bare blevet tydeligere og mere accelererede.”

For Visti at se, er der dog noget ved den digitale billedkonfiguration, der gør den mere ustabil, end vi har været vant til: “I tilfældet med det digitale billede, så siger mit interface – skærmen – om sig selv, at det er en form for fotografi. Men i virkeligheden er det sådan en lille symbolsk maskine, der kan rekonfigurere sig selv, hvis der er behov for det.

Det er et mere ustabilt produkt end et billede, der frembringes ved kemiske processer i det analoge fotografi. Forestillingen om lys, som man kan få overført til en fotografisk film og sidenhen til papir, er en noget mere genkendelig og fast form, end den elektriske konfiguration af et pixelarray i en skærm. Fordi det hele tiden bare er en symbolsk maskine, der ikke er knyttet så tydeligt til noget mekanisk, hvor det, der transformerer kan repræsentere, og det, der repræsenterer kan transformere.”

Det er netop dette, der ifølge Visti gør det digitale billede så eksotisk: “Selvom man forestiller sig det som et lagret fotografi et sted, så er det i virkeligheden en algoritme. Og det er det, der er så vanvittigt, og det, der gør det så kompliceret at sige, hvad repræsentation er nu – og i udstrakt grad nu, hvor Machine Learning er involveret. Så man ender med sådan en enorm sum af funktioner, der potentielt kan indvirke på det pixel array, der udgør det visuelle billede. Så hvordan går man overhovedet i gang med at finde ud af, hvad et billede er for noget?”

TEMA: Netkunst

Læs om kunst, der er udviklet til at eksistere online, og som bruger nettet som sit ‘materiale’. Med vores temaserie får du baggrundsviden og kendskab til kunstnere indenfor genren.

TEMA: Netkunst

Læs om kunst, der er udviklet til at eksistere online, og som bruger nettet som sit ‘materiale’. Med vores temaserie får du baggrundsviden og kendskab til kunstnere indenfor genren.